Bing ha riferito che utilizza il BERT da aprile tanto che le capacità di elaborazione del linguaggio naturale sono ora applicate a tutte le query a livello globale.

Bing da mesi utilizza il BERT per migliorare la qualità dei risultati di ricerca e a riferirlo è direttamente Microsoft, tanto che i transformer model sono stati applicati a tutte le varie tipologie di richieste fatte dagli utenti al motore di ricerca.

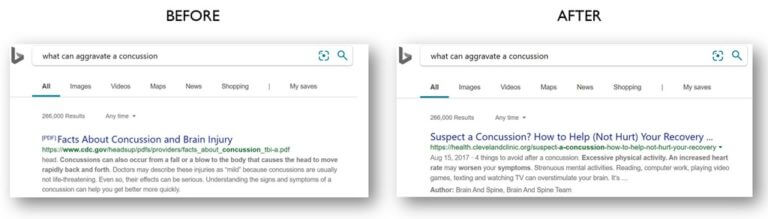

Nell’esempio qui sopra, come si può leggere, le migliori capacità di elaborazione del linguaggio naturale di Bing consentono al motore di ricerca di capire cosa l’utente sta cercando online. Nello specifico è stato chiesto a Bing “cosa può aggravare una commozione cerebrale”.

Prima dell’aggiunta dei nuovi transformer model, i risultati alla domanda fornivano risposte riguardanti i sintomi di una commozione cerebrale, mentre ora forniscono risposte più esaurienti e specifiche.

Se si guarda il prima e il dopo aprile si vede come Bing ha iniziato a dare risposte sempre più precise in funzione della ricerca fatta dall’utente.

Una migliore comprensione del linguaggio naturale dovrebbe portare a risultati di ricerca più rilevanti per gli utenti.

Da qualche mese sappiamo che sia Bing che Google utilizzano questi algoritmi avanzati per fornire risultati di ricerca migliori, in particolare quelli che riguardano le longer query.

Oggi possiamo dire che l’implementazione del BERT da parte di Bing, per migliorare i suoi risultati di ricerca, precede di sei mesi l’annuncio del BERT di Google e Bing afferma che questo ha portato a ulteriori miglioramenti nella qualità della ricerca nell’ultimo anno.

Come funziona il BERT di Bing

“A differenza delle precedenti architetture di reti neurali profonde (deep neural network o DNN) che elaboravano le parole singolarmente in ordine, i nuovi transformer model comprendono il contesto e la relazione tra ogni parola e tutte le parole che la circondano in una frase”.

A dirlo è Jeffrey Zhu, program manager di Bing Platform, il quale aggiunge che “a partire da aprile di quest’anno, abbiamo utilizzato transformer model di grandi dimensioni per fornire ai nostri clienti ulteriori miglioramenti qualitativi rispetto all’anno scorso”.

Il BERT si basa sulle capacità di apprendimento profondo utilizzato nelle funzioni di ricerca intelligente di Bing, come le risposte intelligenti che attingono a fonti multiple, la ricerca intelligente delle immagini con riconoscimento degli oggetti e definizioni hover-over per parole non comuni.

Questi miglioramenti possono aiutare Bing a mantenere o a incrementare la sua quota di mercato della ricerca, che continuerà a renderlo una piattaforma valida sia per campagne organiche che a pagamento.

Microsoft ha implementato i transformer model utilizzando Azure N-series Virtual Machines con acceleratori di GPU e quindi ha eseguito ulteriori ottimizzazioni per eseguire il calcolo in parallelo su scala web-search.

[via searchengineland.com]